人脸识别:面对无处不在的眼睛的慎思

作者:段伟文 /

发布时间:2021-01-12/

浏览次数:0次

除非在制度上建立起一套严格的监管与治理体系,使人脸识别技术的应用遵循必要、正当、合理等每个人可以接受的朴素且普遍的价值诉求,刷脸时代高喊“我的数据我做主”无异于梦呓。

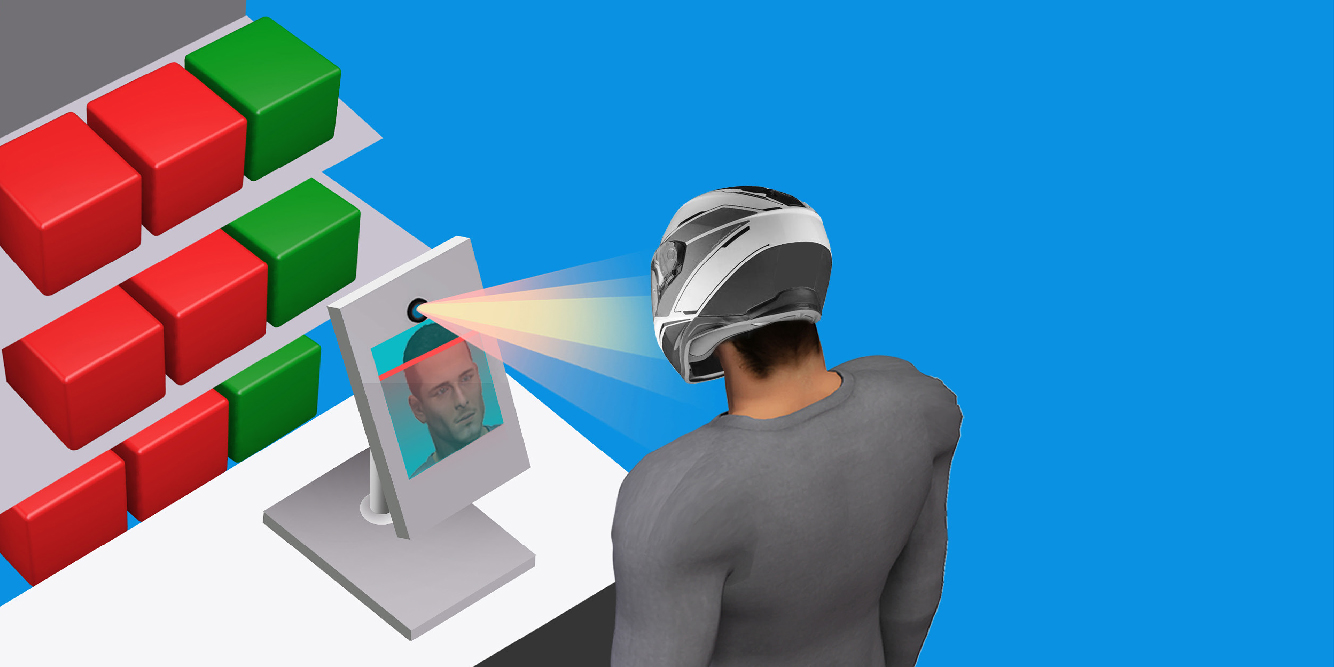

近两年来,人脸识别技术在未经审议与讨论的情况下迅速推广,应用场景越来越多,甚至到了司空见惯的程度。尽管“人脸识别第一案”以及南京、天津在相关争议后出台了某些特定场景应用的禁令,《个人信息保护法》以及《民法典》等相关法律法规的出台和细化必将涉及对人脸识别应用的规制,但仅从交通安检、大学、机关与景区大门的门禁等可见的场景来看,人脸识别应用依然因循着“先应用后治理”的新技术应用思路。各种恶意应用和具有潜在安全与伦理风险的技术滥用没有得到应有的关注。

正因为如此,人脸识别如同漫过堤岸的洪水,越来越多地加装在各种可见的门禁系统和不那么显眼的监控设备之中。问题是,这就是人们想要的智能化的未来吗?

《自然》(Nature)杂志最近就人脸识别的伦理问题对人脸识别、计算机视觉和人工智能的研究人员展开了一项调查,在问及对11个人脸识别场景的舒适程度时,结果显示,从较为接受到难以接受的场景排列是:警方识别嫌犯、机场旅客身份核验、智能手机解锁、公司门禁、公交系统乘客身份核验、学校学生注册和考勤、警方对公共场所的监控、学校对学生行为的评价、雇主对求职者的人格特征和情感的评价、任何人对他人身份的查寻。这些典型场景实际上表明,如果没有舆论关注、社会热议和必要的监管,人脸识别的应用几乎可以无处不在,它对人可能造成的侵略性与潜在危害,也必将随着其精准性和计算速度的提升而变得无以复加。

再也丢不起的“脸”

真实的世界无不充满悖论。从互联网、数字新媒体到大数据和人工智能,数字化和智能化成为本世纪以来的时代引擎,但与之相伴随的是,个人数据的不当采集、大量泄露与非法使用正在使人的隐私、财产等权益受到日益严重的侵害。透过戴头盔买房之类的黑色幽默不难看到,对于在数字世界中几近裸奔的芸芸众生而言,“人脸”实际上已经成为人们退无可退的最后一道防线。

这么说并非危言耸听。人脸原本是每个人最为重要的外貌与人格特征,是人们近距离确认他人身份的主要依据,人脸识别技术则从根本上将识别人脸这种人与人在物理时空的相认,转变成了任何人掌握和部署了这一技术的人可以隐秘地识别、分析和算计他人的监测——无处不在的观察与揣测、全过程的记录和计算。

在摄影技术出现以前,对于大多数人而言,人脸是通过物理时空的近距离识认或观察获得的,经由他人不那么精确的记忆与回忆得到保存或提取。除了基于长时间观察的素描、肖像画或基于短视记忆及其描述的回忆画像以外,人脸的主要呈现形式为人与人彼此近距离面对面的即时印象和由此形成的记忆。这意味着,且不论识别的精准程度,“一个人看到过另外一个人的脸”,实质上是一种对主观体验的陈述,是需要其他在场者做出旁证的有待进一步确认的证言。

随着摄影特别是数字影像技术和人脸识别技术的发展,记录人脸信息的数据越来越精确,成为容易获得与辨识的生物特征数据之一。由于人脸的精确数据可以在非接触的情况下轻易地得到远程采集、识别和分析,而且这些数据既与其原始归属者具有唯一的对应关系,又可以脱离该人而得到存储、复制、研究和变造。相对于指纹、虹膜、步态等其他生物特征数据识别,人脸识别在本质上可以便捷地通过非物理侵入的方式唯一地确认人的身份,使一个人的行为与其唯一身份的关系得到认定。

因此,人脸识别技术的出现从根本上颠覆了人脸在传统物理时空的内涵,不仅使其成为跨越物理时空和信息空间可流动和自动处理的数据,而且在很大程度上演变为与人的身份相关的具有唯一性的数字人格。而这一态势无疑带来了一个全新的悖论:一方面,人脸很可能成为证明“我就是我”即验证人的身份同一性的数字人格;另一方面,人脸数据非但不为我所掌握,人们对谁在采集、谁在出于什么目的处理和使用其人脸数据,诸如这些数据如何被存储、传递、加工、泄露等多半不知晓,更不了解其中的机理机制。也就是说,建立在人脸识别等技术系统的部署之上的数字人格,实质上已然成为一种脱离个人的主体掌控能力的存在。除非在制度上建立起一套严格的监管与治理体系,使人脸识别技术的应用遵循必要、正当、合理等每个人可以接受的朴素且普遍的价值诉求,刷脸时代高喊“我的数据我做主”无异于梦呓。

呼唤更加精细的治理

在任何时代似乎坏消息都多于好消息。虽然“脸”再也丢不起,但科技已经发展到了这一步,我们既不可能捂着脸做人,也不可能全面禁止人脸识别的应用。在西方,尽管欧洲对人脸识别的应用有GDPR之类严格的规制,美国的很多地方出台了禁止或暂停人脸识别的法规,但从长期来看,鉴于其广泛的应用前景与巨大的商机,人脸识别技术的发展最终难以避免。在中国,以隐私换便利与安全,似乎是很多场景下默认、强制或悄悄地部署人脸识别系统的“理由”,但如果技术提供者和部署者不能确保人脸数据的安全性,无法证明该技术不会被滥用,人们对这项颠覆性技术的态度必然会越来越不信任,乃至无比焦虑。

毋庸置疑,不论是全面禁止还是无序生长皆非长久之计,人脸识别应用的下一步必然是对其加以系统而精细的治理。这无疑需要诉诸系统而具体的研究、广泛而公开的讨论乃至精心设计的社会试验,但在此之前,应该对一些根本性的问题有所思考。

首先,要认识到人脸识别技术本身的局限性与边界,对其安全与伦理风险加以评估、预见和治理。目前对于技术局限性的讨论比较多,如由于训练数据样本不足造成的偏差和歧视等。但从技术发展趋势看,使用人脸数据进行的面部分析技术,如对人的年龄,性别、生理、病理、情绪、情感等方面的分析,应该尤其慎重。以疫情防控中热成像扫描与人脸识别技术的结合为例,尽管在跟踪受感染个体上表现出的高效率体现了一定的合理性,但这种类型的多模式生物特征识别系统的出现,模糊了“皮肤上”和“皮肤下”监视之间的界线,从而需要更严格的审查,在进一步的研发应用之前,应对其潜在的安全与伦理风险加以必要的监管。

其次,要意识到普通人面对人脸识别的泛在部署已沦为脆弱群体。仅以商业应用为例,不能让人脸识别技术仅仅成为赋能企业的工具。实际上,国内外很多企业之所以呼吁政府出台明晰的行业规范与监管制度,就是因为担心无序的技术滥用必然会带来巨大的社会舆论反弹和监管风险。对于行政部门而言,过度依赖数字化和智能化实际上真正导致缺乏温度的新型的“机器官僚主义”。

最后,每个人都应该问问自己,包括那些开发者和部署者,一个无处不在的自动识别每个人一颦一笑的未来,是否真的是你想要拥抱的美丽新世界。

作者简介:段伟文,物理学学士、科技哲学硕士、博士,现任中国社科院哲学所科技哲学研究室主任、研究员,中国社科院科学技术和社会研究中心主任,中国社科院大学特聘教授。主要研究领域为科学哲学、信息技术哲学,近年来关注大数据与人工智能的哲学、伦理和社会研究。

除《商学院》杂志署名文章外,其他文章为作者独立观点不代表《商学院》杂志立场,未经允许不得转载。版权所有

欢迎关注平台微信公众号

点赞 30

收藏 20